Ідея квантових обчислень десятиліттями трималася на простій інтуїції: що довше й складніше квантове коло, то більша його «магія». Більше шарів — більше інтерференції, складніші кореляції, багатша структура стану. Саме на цьому припущенні тримаються і знамениті демонстрації квантової переваги, і практичні мрії про прискорення оптимізації, моделювання матеріалів чи хімічних реакцій.

Але реальні квантові процесори живуть у світі, де немає «ідеальних воріт». Кожна операція додає похибку, кожне вимірювання — шум, а кожна зайва мікросекунда — шанс, що кубіт втратить крихкий квантовий стан. Нове дослідження, про яке повідомляють наукові ресурси, підсвічує незручну правду: в умовах шуму квантові комп’ютери поступово «забувають» те, що робили на початку схеми. У підсумку довгі кола все частіше поводяться так, наче вони короткі, — і це радикально змінює оцінку того, на що здатні нинішні NISQ‑пристрої (Noisy Intermediate-Scale Quantum).

Що саме означає «забування» у квантовому колі

Квантове коло — це послідовність шарів (гейтів), які перетворюють початковий стан кубітів на фінальний, після чого ми вимірюємо результат. У підручниковій картині кожен шар «накладається» на попередні, а весь ланцюжок утворює єдине перетворення. Тому в ідеалі ранні операції не менш важливі, ніж пізні: вони формують траєкторію стану в просторі можливостей.

У шумному світі відбувається інше. Похибки діють як невидимий «розчинник» інформації: корисні квантові кореляції деградують, а відмінність між станами, отриманими різними ранніми операціями, з часом стає дедалі менш помітною. Іншими словами, коли коло стає глибшим, внесок перших шарів усе більше розмивається наступним шумом. Залишається те, що було зроблено нещодавно — останні шари мають найвищий шанс дожити до вимірювання без повного стирання.

Цей ефект важливий не як метафора, а як практичне обмеження: якщо дві різні схеми на початку з часом «змиваються» до статистично схожих результатів, то додавання глибини перестає збільшувати обчислювальну потужність. Коло може бути довгим на папері, але ефективно — коротким у поведінці.

Чому це ламає інтуїцію про масштабування квантових алгоритмів

Багато квантових алгоритмів покладаються на глибину як на ресурс. Наприклад, у варіаційних підходах (VQE для хімії чи QAOA для оптимізації) глибина анзацу часто пов’язана з якістю наближення. Теоретично збільшення кількості шарів має давати гнучкіший «клас функцій» і вищу точність. Але якщо шум відтинає вплив ранніх параметрів, то оптимізація починає нагадувати налаштування лише «фінального фільтра», тоді як попередні шари стають майже косметикою.

Ще гостріше це б’є по класу задач, де потрібні довгі ланцюжки логічних залежностей, наприклад, у фазовій оцінці чи симуляції еволюції квантових систем на великих часових масштабах. У таких задачах кожен шар — частина акумуляції фази або кореляції. Якщо накопичення «витікає», результат втрачає сенс швидше, ніж ми встигаємо завершити обчислення.

Важливо: мова не про те, що квантові комп’ютери «не працюють». Вони працюють, але їхня ефективна глибина — та, що реально впливає на вихідний розподіл — може виявитися набагато меншою за фізичну кількість виконаних гейтів.

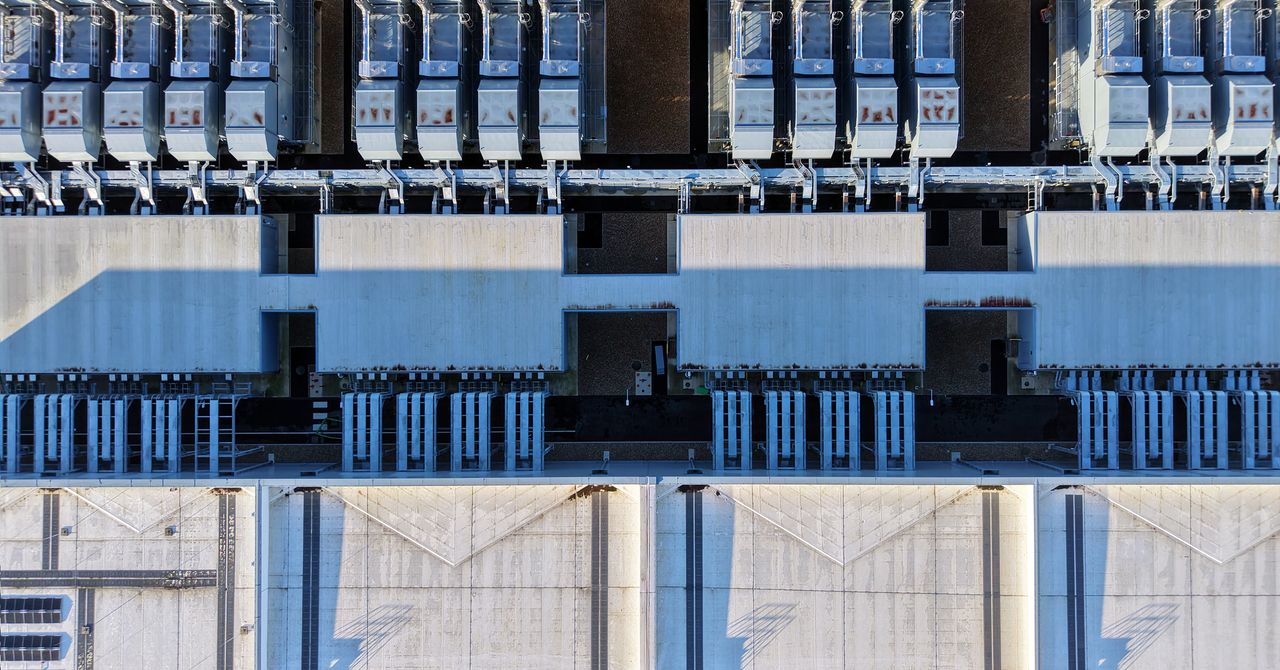

Контекст: NISQ‑епоха і межа між демонстрацією та користю

За останні роки галузь пережила етап гучних демонстрацій: виконання специфічних схем, які складно повторити класичними методами в заданий час. Але перехід від «важко симулювати» до «корисно для бізнесу та науки» упирається в надійність і відтворюваність. Шум завжди був головним ворогом. Новизна нинішнього результату — в тому, що він описує не просто «помилки зростають із глибиною», а структурний наслідок: квантове коло перестає пам’ятати власну історію.

Це нагадує класичний ефект у статистичній фізиці, коли система з часом втрачає інформацію про початкові умови через змішування та флуктуації. У квантових процесорах роль флуктуацій виконує декогеренція й накопичення похибок гейтів. Результат — зниження «довготривалої залежності» між ранніми рішеннями алгоритму та фінальним вимірюванням.

Експертна оптика: що це означає для інженерів і розробників

Уявімо коментар від практичної сторони — квантового інженера, який щодня має справу з калібруванням і помилками. «Ми давно знаємо, що кожен двокубітний гейт — дорогий, — каже (гіпотетично) дослідник з лабораторії квантового контролю. — Але тепер акцент зміщується: справа не лише в тому, що помилки накопичуються. Справа в тому, що після певної глибини ви вже не купуєте додаткову виразність схеми. Ви купуєте шум, який маскує все, що було до цього».

З точки зору розробника алгоритмів це підштовхує до трьох стратегій:

- Компресія схем: агресивне скорочення кількості гейтів через оптимізацію компіляції, пошук еквівалентних перетворень, злиття шарів та зменшення кількості двокубітних операцій.

- Алгоритмічна стійкість: дизайн методів, де корисний сигнал «вплетений» у фінальні шари або може бути відновлений за допомогою повторів і статистичних технік.

- Перехід від глибини до ширини: використання більшої кількості кубітів за меншої глибини — там, де це можливо, наприклад, у певних схемах вибірки або в підходах із допоміжними кубітами для перевірок.

Для бізнесу це також означає корекцію KPI. Якщо ви оцінюєте платформу лише за кількістю кубітів або заявленою максимальною глибиною, ви ризикуєте дивитися не на ту метрику. Реалістичніші показники — це ефективна глибина, стабільність результатів між запусками, якість двокубітних гейтів і здатність системи підтримувати корисні кореляції до моменту вимірювання.

Чи ставить це хрест на квантовій перевазі?

Ні — але уточнює, де саме вона може з’явитися в найближчій перспективі. Якщо глибокі кола деградують до «поверхневих» за поведінкою, то на нинішніх пристроях більш перспективні задачі, які:

- потребують обмеженої глибини, але можуть використати квантову паралельність або інтерференцію в останніх шарах;

- допускають пом’якшення помилок (error mitigation) без повної корекції;

- мають цінність навіть як стохастичні оцінки, а не детерміновані відповіді;

- можуть бути розбиті на короткі підзадачі з класичною «склейкою» результатів.

Натомість великі мрії про універсальні довгі алгоритми на сотнях або тисячах логічних операцій без повноцінної квантової корекції помилок виглядають ще менш реалістично, ніж учора. Новий висновок підкріплює те, що багато лабораторій і так відчували емпірично: «ще один шар» не завжди означає «ще один крок до відповіді».

Дорожня карта: що має змінитися, аби квантові схеми не забували

Єдиний фундаментальний спосіб зламати тенденцію — перейти до режиму, де шум не накопичується неконтрольовано. Це означає:

- Покращення фізичної якості гейтів (нижчі похибки, стабільні калібрування, менша чутливість до дрейфу параметрів).

- Зростання часу когерентності і кращий контроль навколишнього середовища.

- Квантова корекція помилок на практиці: перехід до логічних кубітів, де інформація захищена кодами, а помилки виправляються під час обчислення.

- Архітектурні рішення: топології з меншою потребою в перестановках кубітів, кращі з’єднання, ефективніші двокубітні операції.

До цього моменту індустрія, ймовірно, буде балансувати між двома полюсами: демонстраціями складності (щоб довести прогрес) і прагматичними, коротшими схемами (щоб отримати хоч якусь прикладну цінність). Нове дослідження підсилює аргумент на користь другого полюса: якщо машина «пам’ятає» переважно фінал, то інженерна майстерність полягає в тому, щоб зробити фінал максимально змістовним.

Висновок: тверезість як прискорювач прогресу

Квантові обчислення не втратили перспективу — натомість отримали більш чітке дзеркало. Ефект «забування» показує, що глибина сама по собі не є гарантією сили, коли шум переписує історію схеми на льоту. Для ринку це сигнал перестати продавати абстрактні «шари» та почати говорити про збереження корисної інформації. Для науковців — стимул переосмислити алгоритми так, щоб вони виживали в реальному, а не ідеальному квантовому світі.

У 2026‑му головне питання звучить уже не «скільки гейтів ми можемо виконати», а «скільки з них матимуть значення до моменту вимірювання». І саме відповідь на нього визначить, коли квантові комп’ютери перестануть забувати — і почнуть стабільно обчислювати.